Wanneer is HR-software hoog-risico AI onder de EU AI Act? - Veel HR-afdelingen gebruiken al jaren dezelfde software voor werving, beoordelingen of personeelsplanning. Vaak weten ze niet dat die software nu misschien onder de strengste regels van de AI Act valt. De wet kijkt niet naar het merk of naar hoe lang u het systeem al gebruikt. Het gaat erom wat het systeem precies doet en wat de gevolgen zijn voor individuele medewerkers of sollicitanten.

In dit artikel leest u precies hoe u bepaalt of uw HR AI systemen als hoog-risico kwalificeren, wat de gevolgen zijn als dat zo is, en welke stappen u direct kunt zetten om hoge boetes te voorkomen. We lopen de zeven stappen van de AI Act classificatie beslisboom met u door — toegepast op de meest voorkomende HR-tools.

Niet zeker over uw HR-systeem?

Doe de gratis AI Act Classificatiescan op aicompliancy.nl. In 7 stappen weet u of uw systeem hoog-risico is en welke verplichtingen op u van toepassing zijn. Geen juridisch jargon — gewoon heldere antwoorden.

Waarom HR bijna altijd hoog-risico is

Valt HR-software altijd onder de AI Act hoog-risico categorie? - Niet altijd, maar de kans is groot. De AI Act (Verordening EU 2024/1689) benoemt in Annex III expliciet systemen die worden gebruikt bij werkgelegenheid, personeelsmanagement en toegang tot zelfstandige arbeid als hoog-risico. Concreet: als uw systeem beslissingen ondersteunt of neemt over aanname, afwijzing, promotie, beoordeling of ontslag van individuele personen, valt het in deze categorie.

Het gaat dus niet om het systeem an sich, maar om het gebruik. Een eenvoudige vacatureplaatsingstool is geen hoog-risico AI. Een tool die cv's rankt en de onderste 60% automatisch filtert, waarschijnlijk wel.

De 7 vragen die bepalen of uw HR-software hoog-risico is

Doorloop onderstaande vragen voor elk HR-systeem dat AI of machine learning gebruikt. Bij elke "ja" beweegt u richting de hoog-risico classificatie.

Vraag 1 — Gebruikt het systeem AI of machine learning?

Hoe weet ik of mijn HR-software AI gebruikt? Vraag uw leverancier expliciet of het systeem gebruikmaakt van machine learning, voorspellende algoritmen of geautomatiseerde scoringsmodellen. Functies zoals "automatische kandidaatranking", "fit-score", "verloop-risico" of "prestatievoorspelling" zijn sterke indicatoren. Als het systeem leert van historische data om toekomstige uitkomsten te voorspellen: het is AI.

Vraag 2 — Wordt het ingezet voor HR-processen?

Werving, selectie, beoordeling, promotie, loopbaanadvies, verzuimmanagement of ontslag — als uw AI-systeem een rol speelt in een van deze processen, bevindt u zich in het hoog-risico domein van Annex III.

Vraag 3 — Heeft de output directe gevolgen voor individuen?

Wanneer heeft AI-output directe gevolgen voor individuele medewerkers? Als een fout of een bias in de AI-uitkomst direct leidt tot een nadeel voor een specifieke persoon — geen uitnodiging, een lagere beoordeling, geen promotie — dan is er sprake van directe individuele impact. Dit is de kern van de hoog-risico definitie. Systemen die alleen geaggregeerde rapportages produceren zonder individuele consequenties vallen hier doorgaans niet onder.

Vraag 4 — Kan het systeem discriminatoire uitkomsten produceren?

Elk AI-systeem dat traint op historische HR-data loopt het risico bestaande ongelijkheid te reproduceren of te versterken. Als het systeem beslissingen beïnvloedt op basis van kenmerken die correleren met geslacht, leeftijd, etniciteit of andere beschermde kenmerken — ook indirect — vergroot dat het risico op discriminatie en de kans op hoog-risico classificatie.

Vraag 5 — Is er een mens die de AI-uitkomst altijd kan overrulen?

Dit is een vereiste, geen vraag. Onder de AI Act menselijk toezicht verplichting (Art. 14) moet een bevoegde medewerker de AI-uitkomst altijd kunnen overrulen, het systeem kunnen pauzeren en bij incidenten kunnen ingrijpen. Als uw huidige proces dit niet borgt, moet u dat regelen — ongeacht of het systeem uiteindelijk hoog-risico blijkt.

Vraag 6 — Heeft u technische documentatie van de leverancier?

Welke documentatie moet een AI-leverancier aanleveren? De AI Act verplicht aanbieders van hoog-risico AI om technische documentatie te verstrekken conform Annex IV: hoe werkt het model, op welke data is het getraind, hoe is het getest op bias en fouten? Als uw leverancier dit niet kan overleggen, is dat zowel een contractueel als een compliance-risico.

Vraag 7 — Weten betrokkenen dat AI een rol speelt?

Medewerkers en kandidaten hebben onder de AI Act én de AVG (Art. 22) het recht te weten wanneer geautomatiseerde systemen een rol spelen in beslissingen over hen. Als uw organisatie dit niet communiceert, overtreedt u al de transparantieverplichtingen — ook als het systeem uiteindelijk niet hoog-risico blijkt.

Deze tool geeft een eerste indicatie op basis van de EU AI Act (Verordening EU 2024/1689). De uitkomst is geen juridisch advies en vervangt geen professionele beoordeling. Twijfelt u over de classificatie van uw systeem? Neem contact op voor een persoonlijk adviesgesprek.

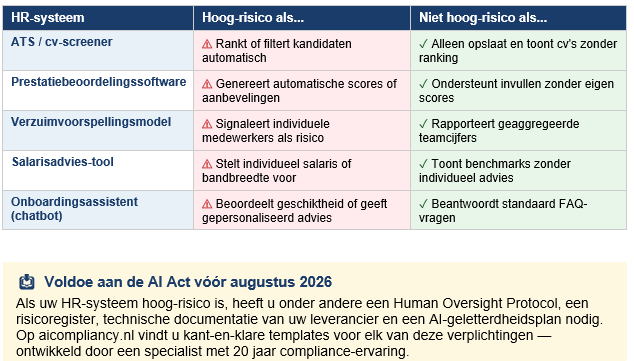

Overzicht: veelgebruikte HR-tools en hun risicoklasse

De tabel hieronder geeft een eerste indicatie per type HR-systeem. De definitieve classificatie hangt altijd af van het specifieke gebruik binnen uw organisatie.

Veelgestelde vragen over HR-software en de AI Act

Is een ATS (Applicant Tracking System) altijd hoog-risico AI?

Niet automatisch. Een ATS dat alleen cv's opslaat en toont is geen hoog-risico AI. Een ATS dat kandidaten automatisch rankt, filtert of scoort op basis van een algoritme valt vrijwel zeker onder de hoog-risico categorie van de AI Act (Annex III, punt 4). Vraag uw leverancier of het systeem gebruik maakt van geautomatiseerde scoring of ranking.

Wat moet ik regelen als mijn HR-software hoog-risico blijkt?

U heeft minimaal nodig: een risicobeheersysteem (Art. 9), technische documentatie van de leverancier (Art. 11), een Human Oversight Protocol met aangewezen toezichthouder (Art. 14), transparantiecommunicatie naar betrokkenen (Art. 50 en AVG Art. 22) en een aantoonbaar AI-geletterdheidsplan voor medewerkers (Art. 4). De deadline voor deze verplichtingen is augustus 2026.

Kan ik hoog-risico HR-software blijven gebruiken na augustus 2026?

Ja, hoog-risico AI is niet verboden — alleen streng gereguleerd. U mag hoog-risico HR-software blijven gebruiken, mits u voldoet aan alle verplichtingen uit de AI Act. De wet verbiedt alleen de toepassingen die in Art. 5 worden genoemd, zoals social scoring en biometrische massamonitoring.

Mijn leverancier zegt dat zijn systeem AI Act-compliant is. Is dat voldoende?

Nee. Als deployer — de organisatie die het systeem inkoopt en gebruikt — bent u zelf verantwoordelijk voor correct gebruik, menselijk toezicht en transparantie naar betrokkenen. U kunt aansprakelijkheid niet volledig bij uw leverancier neerleggen. Controleer of de leverancier daadwerkelijk aan zijn verplichtingen voldoet via een due diligence checklist en leg contractuele garanties vast.

Hoe weet ik zeker of mijn HR-software AI gebruikt?

Vraag uw leverancier expliciet: "Maakt dit systeem gebruik van machine learning, voorspellende algoritmen of geautomatiseerde scoring?" Functies als kandidaatranking, fit-scores, verlooprisico of prestatievoorspelling zijn sterke indicatoren. Bij twijfel: doe de gratis AI Act classificatiescan op aicompliancy.nl.